最近は寒くなったせいか、第二子のことで夜目が覚めるからか、早起きしにくくなってしまい、ブログ更新できないことが多かったですね、、、。ぼちぼち書いていきます。

『現代数理統計学の基礎』をゆっくり進めます。7章の(1)ですね。

正規分布において、分散が既知の場合に、平均値に対する仮説検定を、尤度比/スコア/ワルド検定でそれぞれ行う問題ですね。

まずは尤度比検定から。

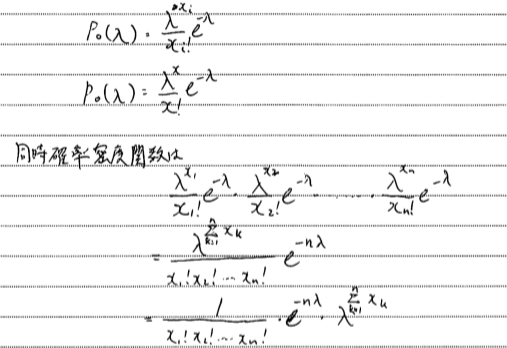

対数尤度関数は

\[

\log L(\mu, x) = -\frac{n}{2} \log 2\pi\sigma^2 – \sum_{i=1}^{n} \frac{(x_i – \mu)^2}{2\sigma^2}

\]

となります。

次に、尤度比の対数をとったものを計算します。

それに -2 をかければ、カイ二乗分布に従うことが言えるので、棄却域が計算できます。

まず、尤度比というのはこれ

\[

\frac{L(\mu_0)}{L(\hat\mu)}

\]

でした。また、正規分布における最尤推定値は

\[

\hat\mu = \bar{X}

\]

となります。

よって尤度比の対数をとって、-2 をかけたものは

\[

2\log L(\hat\mu) – 2\log L(\mu_0)

\]

\[

= -2 \sum_{i=1}^{n} \frac{(x_i – \hat\mu)^2}{2\sigma^2} + 2 \sum_{i=1}^{n} \frac{(x_i – \mu_0)^2}{2\sigma^2}

\]

\[

= -\frac{1}{\sigma^2} \left\{ \sum_{i=1}^{n} (x_i – \bar{X})^2 – \sum_{i=1}^{n} (x_i – \mu_0)^2 \right\}

\]

\[

= -\frac{1}{\sigma^2} \left\{ -2\bar{X} \sum_{i=1}^{n} x_i + n\bar{X}^2 + 2\mu_0 \sum_{i=1}^{n} x_i – n\mu_0^2 \right\}

\]

ここで

\[

\sum_{i=1}^{n} x_i = n\bar{X}

\]

なので

\[

= -\frac{1}{\sigma^2} \left\{ -n\bar{X}^2 + 2n\mu_0\bar{X} – n\mu_0^2 \right\}

\]

\[

= -\frac{n}{\sigma^2} (\bar{X} – \mu_0)^2

\]

これがカイ二乗分布に従うので検定のための棄却域は

\[

-\frac{n}{\sigma^2} (\bar{X} – \mu_0)^2 > \chi_{1,\alpha}^2

\]

となります。

実はこの問題はやってることが前書いた記事とほぼ一緒なんですね(汗

各検定に対してネットで調べた時に出てくる代表的な例題はみな同じようなものだと思いますが…。

尤度比検定、ワルド検定、スコア検定をできるだけ分かりやすくまとめる【統計検定1級対策】 – 脳内ライブラリアン

続いてワルド検定。

ワルド検定では漸近有効性による以下の特徴を利用します。

\[

\sqrt{n} I_1(\hat\mu)(\hat\mu – \mu_0) \sim N(0,1)

\]

というわけで必要なのはフィッシャー情報量です。

まず対数をとった確率密度関数をパラメータで2回微分して負の期待値をとる方法で出していきます。1回微分して

\[

\frac{\mu}{d\mu} \left\{ -\frac{1}{2} \log 2\pi\sigma^2 – \frac{(x – \mu)^2}{2\sigma^2} \right\}

\]

\[

= -\frac{\mu}{d\mu} \frac{(x^2 – 2\mu x + \mu^2)}{2\sigma^2}

\]

\[

= -\frac{(-x + \mu)}{\sigma^2}

\]

もう1回微分して

\[

-\frac{\mu}{d\mu} \frac{(-x + \mu)}{\sigma^2} = -\frac{1}{\sigma^2}

\]

これの負の期待値をとるとデータ1個分のフィッシャー情報量となるので

\[

I_1(\hat\mu) = -E\left[-\frac{1}{\sigma^2}\right] = \frac{1}{\sigma^2}

\]

最初の式に当てはめると

\[

\sqrt{\frac{n}{\sigma^2}} (\bar{X} – \mu_0) \sim N(0,1)

\]

こうなりました。

二乗して棄却域を求めると

\[

\frac{n}{\sigma^2} (\bar{X} – \mu_0)^2 > \chi_{1,\alpha}^2

\]

尤度比検定の場合と一致します。

最後にスコア検定。

帰無仮説におけるスコア関数を利用します。スコア関数は以下の式において、標準正規分布に従います。

\[

\frac{S(\mu_0)}{\sqrt{n} I_1(\mu_0)} \sim N(0,1)

\]

まず、スコア関数は対数尤度関数をパラメータで微分することで得られますので

\[

S(\mu_0) = \frac{\mu_0}{d\mu_0} \sum_{i=1}^{n} \log f(x_i)

\]

\[

= -\sum_{i=1}^{n} \frac{(-x_i + \mu_0)}{\sigma^2}

\]

\[

= \frac{(n\mu_0 + n\bar{X})}{\sigma^2}

\]

となります。

先ほど求めたフィッシャー情報量と合わせて、最初の式に代入して

\[

\frac{(n\mu_0 + \bar{X})}{\sigma^2} \cdot \sqrt{\frac{\sigma^2}{n}}

\]

\[

= \sqrt{\frac{n}{\sigma^2}} (\mu_0 – \bar{X}) \sim N(0,1)

\]

これも二乗して棄却域を求めると

\[

\frac{n}{\sigma^2} (\bar{X} – \mu_0)^2 > \chi_{1,\alpha}^2

\]

となり、他の検定と一致しました。

コメントを残す