仮説検定において「有意水準αの検定を求めよ」みたいな問題を最近よく解いておりますが、単純仮説の場合はいいんですけれども、複合仮説の場合がどうも理解できなかったので、まとめ直してみました。

まず、単純仮説・複合仮説の定義から順番に考えて、例題を解いてみます。

目次:

単純仮説と複合仮説とは

単純仮説はその仮説下でパラメータの値が一つに決まるもの、複合仮説は一つに決まらないものを指します。

具体的に示しますと、帰無仮説 \( H_0 \) において \( H_0:\theta=0 \) とか \( H_0:\theta=\theta_0 \)(定数)みたいなのは単純仮説です。

逆に \( H_0:\theta < 0 \) や \( H_0:\theta < \theta_0 \) みたいなのは複合仮説と言われます。値が一つに決まってないからですね。

表現の仕方の違いですが、単純仮説では確率分布が一つに決まる、複合仮説では複数になる、と言われたりもします。パラメータによって確率分布は変わるのでこれはただ言い方が違うというだけです。

有意水準αの検定とは

サイズαの検定と呼ばれることもあります。

定義としては

\( P(検定の棄却域) = \alpha \)

となるような検定です。

実は正確な定義として、帰無仮説が \( \theta \in \Theta_0 \) を満たすとすると( \( \Theta_0 \) は満たすパラメータの集合)

\( \sup_{\theta \in \Theta_0} P(検定の棄却域) = \alpha \)

となるのですが。自分の場合、ここでなぜ確率上限を示す sup が出てくるのか分からなくなりました。同じような人はぜひ記事を読み進めてください。

単純仮説の例

まずは単純仮説の場合を考えてみます。例題として次を考えます。

例題: サンプル \( X_1, X_2, …, X_n \sim N(\mu,1) \) があるとする。ここで \( \mu \) は未知のパラメータである。帰無仮説 \( H_0:\mu=0 \)、対立仮説 \( H_1:\mu>0 \) とするとき、有意水準 α の尤度比検定を求めよ。

帰無仮説が単純仮説の場合は簡単で、過去の記事で一度やっています。

ここに \( \sigma=1, \mu_0=0 \) を代入すればいいので

\( \sqrt{n} \bar{X} \sim N(0,1) \) となります。(対立仮説から、片側検定であるためχ二乗分布ではなく正規分布に従うことを用いています)

よって棄却域は正規分布の α% 分位点を \( z_\alpha \) として

\( \sqrt{n} \bar{X} > z_\alpha \) となります。

これは当然のことながら

\( P(\sqrt{n} \bar{X} > z_\alpha) = \alpha \)

となるので、解答となります。

単純仮説の場合は比較的迷うことなく分かります。

複合仮説の例

例題の条件を少し変えて考えてみます。

例題2: サンプル \( X_1, X_2, …, X_n \sim N(\mu,1) \) があるとする。ここで \( \mu \) は未知のパラメータである。帰無仮説 \( H_0:\mu \leq 0 \)、対立仮説 \( H_1:\mu > 0 \) とするとき、有意水準 α の尤度比検定を求めよ。

複合仮説の場合は前述のように、有意水準 α の検定というのは以下の条件になります。

\( \sup_{\mu \leq 0} P(検定の棄却域) = \alpha \)

なんでこうなるのか、多分分かる人には至極当然なんでしょうけれども、数学的センスのなさ故にさっぱりだったので、図をみて考えてみます。

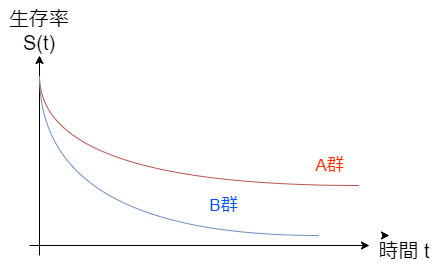

先ほどの記事で使った図ですが尤度比検定はこの二つの差をみています。単純仮説の場合は \( \mu = 0 \) でしたので単純にそれを計算すればOKです。

複合仮説の場合はどうなるかというと

\( \mu \) は上図の範囲のどこかの値ということになります。

当然そうすると \( P(検定の棄却域) \) の値も変わってくるわけですが、大事なのはどこの時の値か、ということ。

定義式が示す通り、もっとも大事なのは一番大きい値です。棄却域に入る確率がせいぜい高くてもここまでと決まっていることが重要なんです。

例えば、有意水準を \( p=0.05 \) としたとき、データを出して \( p=0.03 \) で棄却することや \( p=0.04 \) で棄却することは構いませんが、\( p=0.08 \) を棄却されたら困るでしょう。一番大きい値を保証することが必要なので、定義としてその複合仮説で最も大きい値である上限を用いて

\( \sup_{\mu \leq 0} P(検定の棄却域) = \alpha \)

とするわけです。

この前提に立って、さきほどの問題をみてみます。

単純仮説の場合に求めた棄却域を使って考えてみると \( \mu = 0 \) のとき

\( P(\sqrt{n} \bar{X} > z_\alpha) = \alpha \) となります。

この検定の棄却域を用いて、\( \mu \) の範囲が拡大した場合を考えます。\( \mu \leq 0 \) を条件として \( \mu \) を定数としてとらえると

となります。これを利用しつつ、先ほどの検定の棄却域を保ったまま変形すると

\( P(\sqrt{n} (\bar{X} – \mu) > z_\alpha – \sqrt{n} \mu) = P(Z > z_\alpha – \sqrt{n} \mu) \)

ここで \( Z \) は標準正規分布に従う確率変数とします。

すると \( \mu \) は負であることから

\( P(Z > z_\alpha – \sqrt{n} \mu) \leq P(Z > z_\alpha) \)

となります。ここが分からない人は以下の記事を参照ください。汚い図で説明してます。

よって、確率上限が \( \alpha \) であることが確認できたので、有意水準 \( \alpha \) の検定は

\( \sqrt{n} \bar{X} > z_\alpha \)

となります。単純仮説で示した値がちょうど確率上限であったので、同じになるのです。もちろんそうならない場合もありますし、どこが上限になるのかは注意が必要です。

ちなみに上記の p 値の記事に若干嘘がありまして、p 値の定義式も複合仮説の場合を含めて正確にいえば

\( \sup P(ある検定統計量 > 実際の検定統計量の観測値 | 帰無仮説の条件) \)

なのです。これも結局一番大きい値が大切なので、確率上限が用いられています。

*2023.01.19 追記:記事内の上界と上限の用語が間違っており、コメントをいただきましたので修正しました

参考文献:

上界じゃなくて上限じゃないでしょうかね。

>kkさん

コメント有難うございます。おっしゃる通りです、大変申し訳ありませんでした。

記事は修正させていただきました。ご指摘どうも有難うございます。